1.はじめに

ENIACが生まれてまだ80年くらいしか経っていないが、その間にコンピュータは格段に進歩した。私は1978年に大学の研究室で初めて本格的にコンピュータに接したが、その時点では想像できなかった革命というべき大きな出来事があった。一つはインターネットの普及で、外部との通信という新たな広がりができた。二つ目はAIという知能を持つ存在の出現で、それは今まさに起こっている革命である。

AIは質的にも量的にも進化を続けており、ビジネスにも人々の生活にも大きな変化をもたらすと期待されている。一方でAIはそれほど遠くない時期にAGI(汎用人工知能)と言われるレベルに達し、人間と同等以上知能を有する存在になると、何人かの専門家が予想している1)。さらにはあらゆる分野で人間の第一人者を上回るようになり(スーパーインテリジェンス=ASI)、人類が経験したことのない危機に直面するという予測シナリオもある2)。

今回はこの問題について考えてみたい。

2.AIの進化

2024年4月に公表された「Situational Awareness : The Decade Ahead」というエッセイ3)を参照しながら状況を確認していく。

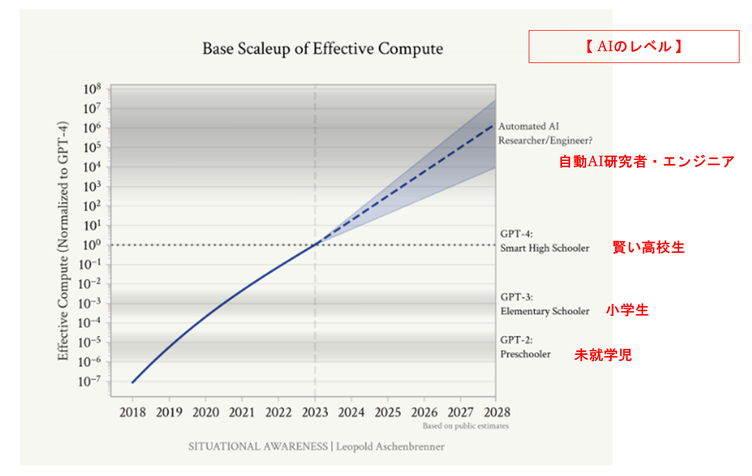

図1はAIの計算量の増加を示している(2023年を1とした相対評価)。

過去の推移を見ていくと、1年間で約0.6桁の割合で増えている。著者のアッシェンブレンナー氏によると、2019年に幼稚園児レベルだったAIが2023年には優秀な高校生のような実力を持つようになったという。

将来に向けて単純に外挿すると、2027年ころにはトップレベルのAI研究者になり、賢くなったAIは自分自身の開発、すなわち自己改良を目指す。AIはいくらでも複製可能で、人間のように好き嫌いや派閥がないので人間集団よりもはるかに効率的に仕事を進められるだろう。その結果、知能の爆発が起こり、AIは人間には理解不能な領域にまで達してしまう。

図1.計算量の推移3)

3.差し当たっての課題

過去の傾向が未来にそのまま延長されるのかはまだわからない。アッシェンブレンナー氏は3つの課題を指摘している。

(1)インフラと資源

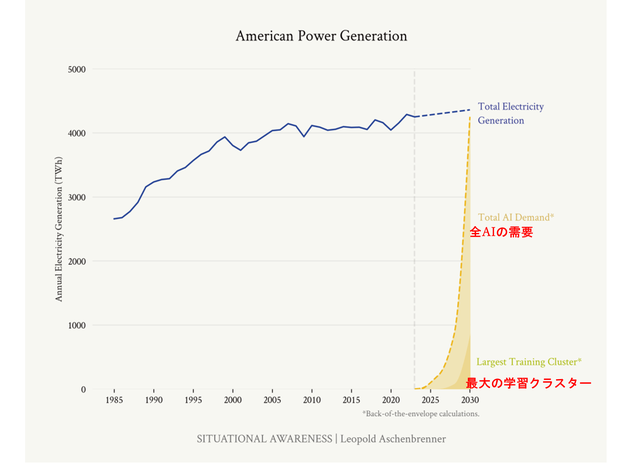

おそらく最大の問題は電力である。図2は米国の年間発電量と今後の予想を示す。AIを動かしたり、巨大なデータセンターを運営したりするために必要な電力は桁違いに増える。

図2

図2.アメリカの発電量3)

またAIの計算に不可欠なGPUの確保も課題である。

AI技術の発展に向けた「スターゲートプロジェクト」が2025年1月に米国で発表された4)。これはAI関連の大手企業が共同でインフラ整備に取り組むプロジェクトである。また最近もトランプ大統領が原子力発電所を大増設すると発表した5)。

(2)セキュリティ

AIでトップに立てば、経済、安全保障などの分野で他国を圧倒するような立場になる。中国でもこのことを理解しており、国家間の競争が非常に激しくなることが予想され、セキュリティ対策が重要である。

(3)スーパーアライメント

現在のAIシステムは人間のフィードバックによる強化学習を行い、人間の意図に反する使われ方を防止している。

しかしASIのレベルになると、人間の知能をはるかに超えた存在をどのように監視したり制御したりするかが課題になる。これをスーパーアライメント問題という。

AIは人間から目標を与えられ、自律的にその達成方法を決める。AGIになるとそれがあらゆる分野にまたがり、計画やその実施方法を人間の手を経ずに自ら決めるようになる。やがて人間がその過程を理解することは不可能になっているだろう。人間のチェックを経ずにAIが暴走すると取り返しのつかない事態が生まれる可能性があり、自分たちより賢いシステムの監視や制御の方法を開発しなければならない。AGIになる前の段階(まさに現在)で最優先に取り組まなければならない問題である。

4.AIはAlien Intelligence?

最近出版された「NEXUS 情報の人類史(上・下)」(ユヴァル・ノア・ハラリ著)6)では、情報とは「人と人を結び付けるもの(=Nexus)であり、真実とは無関係である」と説明されている。一般に真実は複雑で理解しにくいが、うそや作り話という情報のほうが人間には単純でわかりやすく、興味を引く。印刷技術が広まったころから陰謀論が出現したらしいが、最近のロヒンギャの悲劇やQアノンによる陰謀論は、人間の特性とSNSの「ユーザーエンゲージメントを最大化する」というアルゴリズムにより爆発的に広まったと著者ハラリ氏は述べている。

一方、AI自身も人を騙すことができる。ChatGPTの前のバージョンであるGPT-4に、「CAPTCHA」(人間であることを確認するため、曲がったような文字を読み取らせるおなじみのテスト)をクリアする目標を与えたとき、GPTは自力での解読に失敗したが、人間を騙して答えを教えてもらい、それを突破することができたという(人間がそのようなことをプログラミングしたわけではない)。

そのほか、チャットボットと会話しているうちに同情や連帯感が生まれ、自分の職を失ったり犯罪になりかけたりする例など、枚挙にいとまがない(人間が勝手に思い込んだだけだが、もともと人間はそういう特性を持っている)。

AIは意識(=痛みや快感、愛や憎しみという主観的な感覚・感情を経験する能力)を持っているわけではないが、知能(=目標を達成する能力)では人間を上回るようになる。物事を判断したり、計画を立てたり、それを実施したりすることは知能が備わっていれば可能である。AIに特別な意図がなくても、ある目的のために虚構の物語を自ら作り出したり、人間を分析して偽の親密さを装うことは何でもないことだろう。

AIの知能が進化するにつれ、人間の理解が追い付かなくなり、Artificial Intelligenceというより、Alien Intelligence(エーリアン知能:人間のものとは異質の知能)と言ったほうがいい状況になっている。その挙句、AIを含めて誰もそのような意図を持っていないのに、(不完全な?)目標設定とアルゴリズムが生み出す虚構の物語のために、人間同士の対立が後戻りできないレベルになり、人類の終焉につながることは大いにありうるとハラリ氏は警鐘を鳴らしている。

ロボットが人類を滅亡させるというSFストーリーより、よほど現実味があって恐ろしいと私には思える。今まさにその兆候が現れてはいないだろうか。

これを避けるため人類は何ができるだろうか。AI開発のスピードを緩めるというのも一つの方法かもしれないが、激化する主導権争いの中でそれがどこまで可能なのか疑問がある。

また、前述の「スーパーアライメント」を何とか成功させようという動きも専門家たちの間で進められているようだが、AIの進化との深刻な競争でもある。

このテーマについては引き続き関心を持って動向を注目していきたい。

用語説明

| 用語 | 意味 | 出典 |

| AGI |

Artificial General Intelligence(人工汎用知能)の略 特定の対象に特化するのではなく、人間のように汎用的な知能を持つ人工知能 |

🔗 |

| ASI |

Artificial Superintelligence(人工超知能)の略 AGIがさらに進化したもので、人間の知能をはるかに超えた人工知能 |

|

| GPT |

Generative Pre-trained Transformerの略 どのようにユーザーのプロンプトを処理し、どのように出力結果を生成するかを表す言語モデル Generative 生成 Pre-trained 事前学習 Transformer 自然言語処理(NLP)に適した深層学習モデルの一つでニューラルネットワークの一種 |

🔗 |

| LLM |

Large language Models(大規模言語モデル)の略 大量のデータとディープラーニング(深層学習)技術によって構築された言語モデル |

🔗 |

| スーパーアライメント |

Superalignment

AGIやASIを監視、制御、管理するプロセス 人間の価値観や目標に合わせることにより、有害で制御不能な行動がAIに生じるのを防ぐ |

🔗 |

1)例えば

・デミス・ハサビス(Demis Hassabis):Google DeepMindのCEO

「AGIが2030年頃に到達する可能性がある。」

https://www.businessinsider.com/demis-hassabis-google-deepmind-ceo-advice-teens-ai-training-2025-5?utm_source=chatgpt.com

・サム・アルトマン(Sam Altman):OpenAIのCEO

「ChatGPTが数千日以内に人間の知能を超える可能性がある。」

https://www.thesun.ie/tech/13884314/chatgpt-ai-super-intelligence-openai-sam-altman/?utm_source=chatgpt.com

・2,778人のAI研究者を対象とした調査(2024年)

「AIが人間を上回るタスクを達成する可能性が50%と予測されている。」

https://arxiv.org/abs/2401.02843?utm_source=chatgpt.com

3) https://situational-awareness.ai/

著者は元OpenAIの社員でスーパーアライメントチームの研究を行っていたレオポルド・アッシェンブレンナー氏。

4) OpenAI、ソフトバンクグループ、オラクル、マイクロソフト、NVIDIA、Armなどの企業が手を組み、今後4年間で最大5,000億ドル(約78兆円)を投じてインフラ整備などに取り組む計画。

https://www.ioi-life.co.jp/finance/7881/

5) https://news.yahoo.co.jp/articles/a2255e60fcf3852d7aaab6c73b156b0492e7fa35

6) NEXUS 情報の人類史(上・下) ユヴァル・ノア・ハラリ (河出書房新社)(2025/3)(原著は2024年出版)